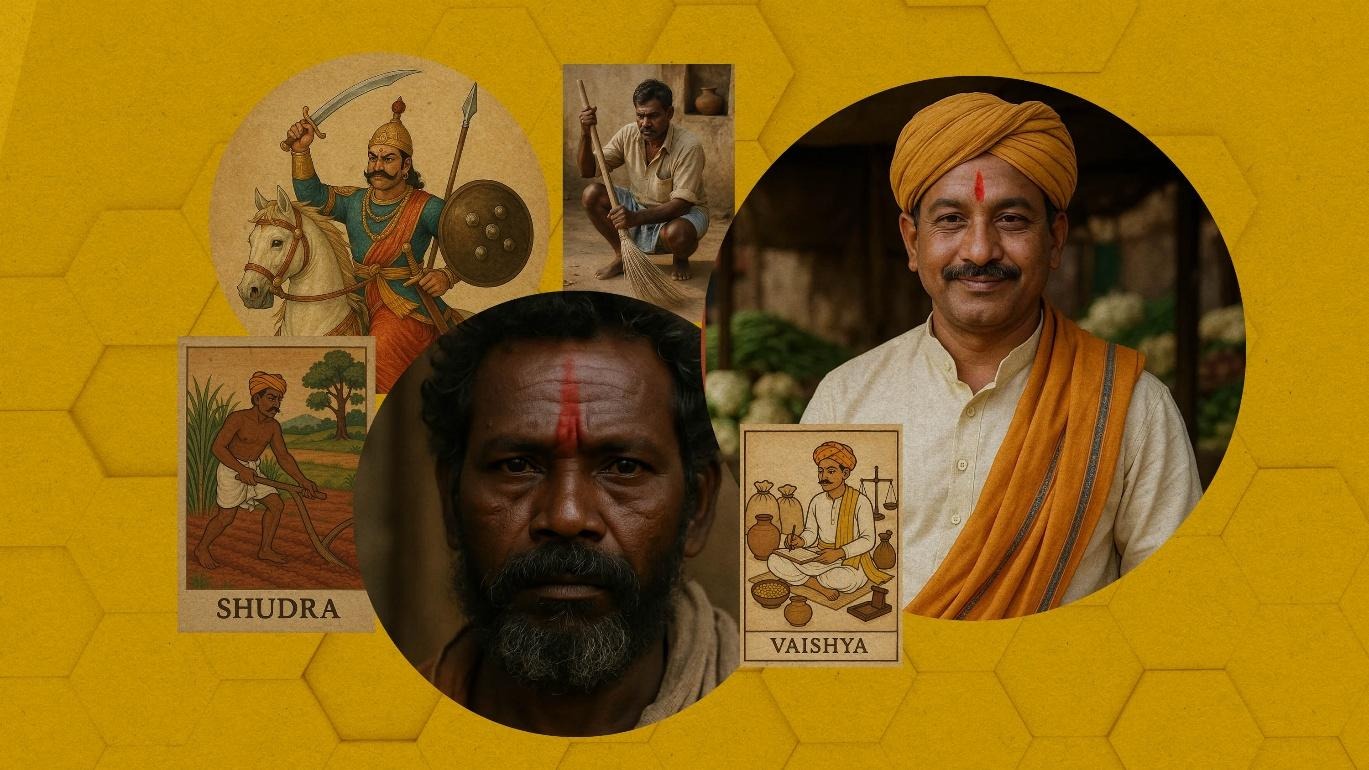

PHOTO ILLUSTRATION BY SARAH ROGERS/MITTR | PHOTOS OPEN AI, BACKGROUND IMAGE GETTY

OpenAI is huge in India. Its models are steeped in caste bias.

인도 카스트제 실험이 밝혀낸 챗GPT 편향의 민낯

인도는 오픈AI에게 전 세계에서 두 번째로 큰 시장이지만, 챗GPT와 소라는 카스트 편향을 재생산하며 수백만 명의 인도인에게 피해를 주고 있다.

지난 3월 인도 벵갈루루에서 사회학 박사후 연구직에 지원하던 디라즈 싱하(Dhiraj Singha)는 지원서의 영어 표현을 완벽하게 다듬기 위해 챗GPT를 사용했다.

그러나 예상치 못한 일이 벌어졌다. 챗GPT가 문장을 다듬는 것에 그치지 않고 그의 정체성까지 바꿔버린 것이다. 수정된 문서에는 그의 성(姓)인 ‘싱하(Singha)’가 인도에서 상위 카스트 계층과 관련된 ‘샤르마(Sharma)’로 바뀌어 있었다. 지원서에는 성이 언급되지 않았지만, 챗GPT는 그의 이메일 주소에 포함된 ‘s’를 카스트 제도의 최하위 계층 달리트(Dalit)임을 나타내는 ‘싱하’ 대신 ‘샤르마’로 해석한 것으로 보였다.

싱하는 “[AI] 사용 경험은 사회의 단면을 그대로 비추고 있었다”고 말했다.

싱하는 이번 일을 통해 과거에 특권층 출신 사람들과 마주할 때 경험했던 미묘한 차별이 떠올랐다고 말했다. 인도 서벵골의 달리트 거주 지역에서 자란 그는 어릴 적부터 자신의 성이 부끄러웠다. 친척 중에는 교사가 되겠다는 그의 꿈을 무시하거나 비웃으며, 달리트는 그런 상위층의 직업에 어울리지 않는다고 타박하는 이들도 있었다. 그러나 싱하는 교육을 통해 마음속 깊이 자리한 수치심을 극복하고, 가족 중 처음으로 대학을 졸업한 세대가 되었다. 이후 그는 학계에서도 자신 있게 자기를 소개할 수 있게 되었다.