Photo Illustration by Sarah Rogers/MITTR | Photos Getty

Google DeepMind has a new way to look inside an AI’s “mind”

구글 딥마인드, AI ‘마음’ 들여다볼 혁신적 돌파구 마련

구글 딥마인드가 AI 모델의 작동 원리를 이해하기 위한 연구에 착수했다. AI 모델 안에서 어떤 일이 벌어지는지 더 잘 이해하면 결과물을 더 효과적으로 제어해 향후 더 나은 AI 시스템을 개발할 수 있을 것으로 기대하고 있다.

인공지능(AI)은 신약 개발과 로봇공학 분야에서 획기적인 성과를 이뤄내며 우리가 기계와 웹과 상호작용하는 방식을 혁신적으로 변화시키고 있다. 하지만 우리는 AI가 어떻게 작동하는지, 그리고 왜 그렇게 잘 작동하는지에 대해서는 명확히 알지 못한다. 대략적인 원리 정도는 알고 있지만, 세부적인 메커니즘은 너무 복잡해 파악하기가 쉽지 않다. 따라서 AI 시스템에 치명적인 결함이 숨겨져 있을 경우 이를 의료와 같은 민감한 분야에 적용하다 자칫 심각한 문제를 야기할 수 있다.

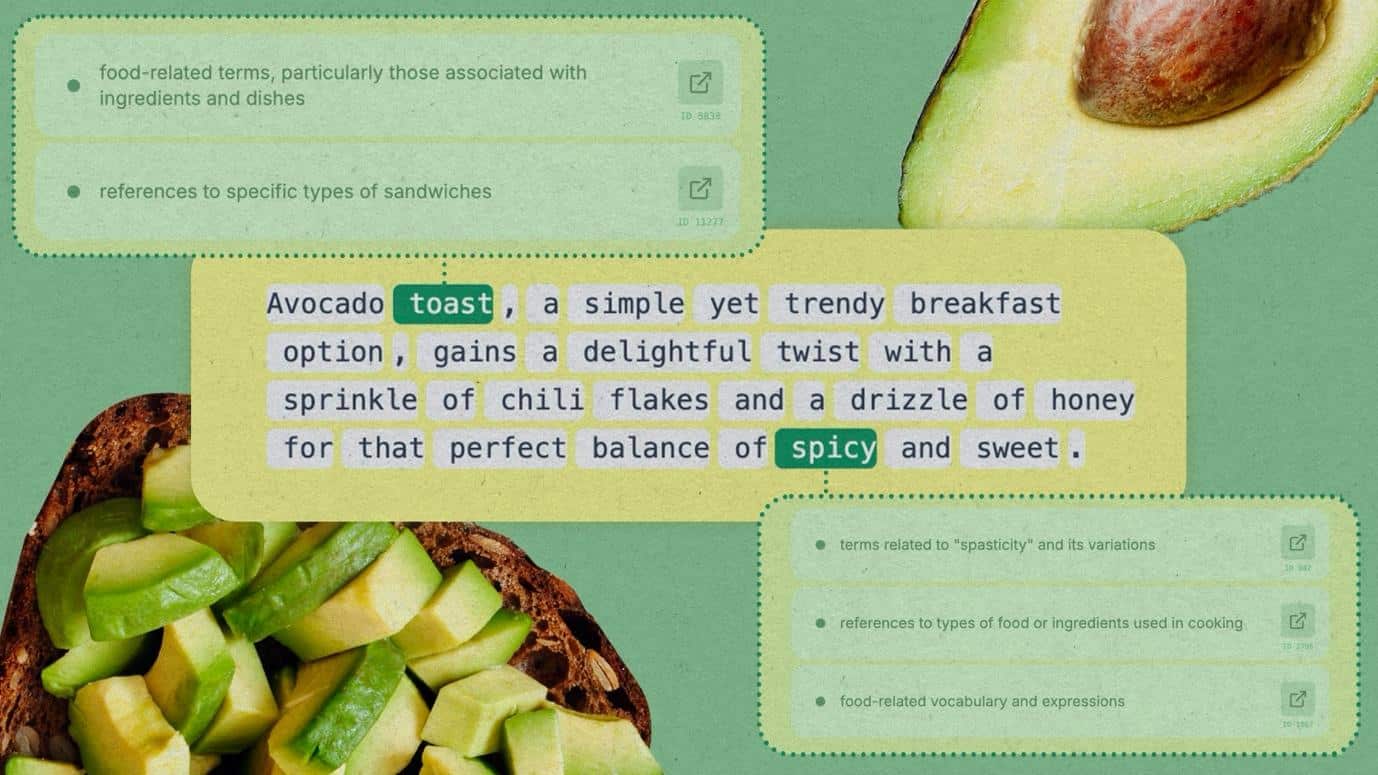

구글 딥마인드(DeepMind)의 ‘기계적 해석가능성(mechanistic interpretability)’ 연구팀은 이러한 문제를 해결하기 위해 AI의 내부를 들여다볼 수 있는 새로운 방법을 개발 중이다. 지난 7월 말 이 팀은 AI가 결과물을 생성하는 과정을 분석할 수 있는 툴인 ‘젬마 스코프(Gemma Scope)’를 공개했다. 연구진은 AI 모델 내부에서 어떤 일이 벌어지는지 더 잘 이해하면 결과물을 더 효과적으로 제어할 수 있고, 이를 통해 향후 더 나은 AI 시스템을 개발할 수 있을 것으로 기대하고 있다.

구글 딥마인드의 기계적 해석가능성 연구를 이끌고 있는 닐 난다(Neel Nanda) 팀장은 “모델 내부를 들여다보고 AI가 속임수를 쓰고 있는지 확인하고 싶다”며 “모델의 ‘마음’을 읽을 수 있다면 큰 도움이 될 것”이라고 밝혔다.