인공지능이 언어를 이해하지 못 한다는 증거

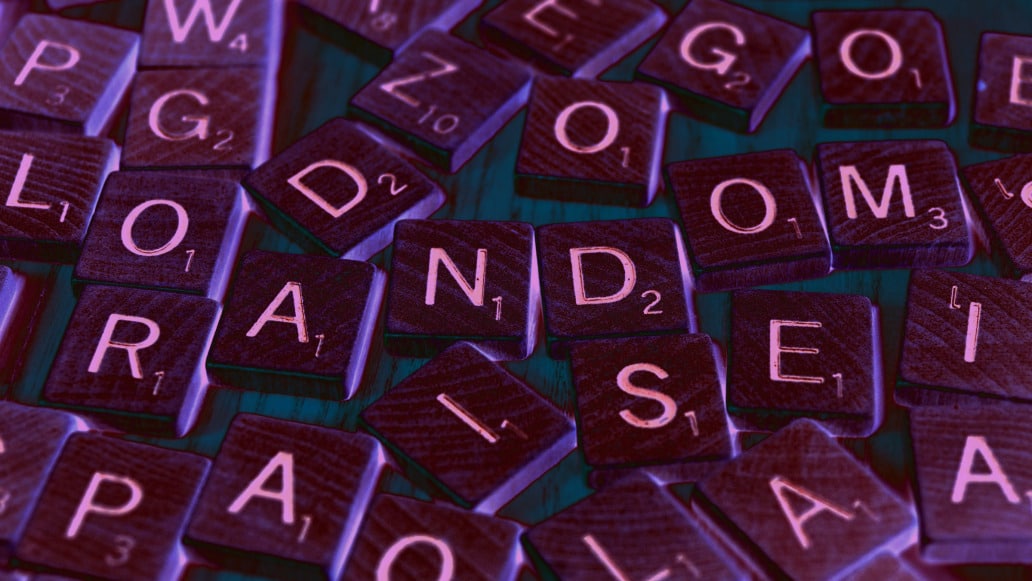

많은 인공지능(AI)이 언어를 이해하는 것처럼 보이고, 문해력 테스트에서 사람보다 더 높은 점수를 받기도 한다. 그러나 이들 AI 대부분은 문장의 단어가 뒤죽박죽 섞여 있어도 알아채지 못 한다. 이는 AI가 실제로 언어를 이해하는 것은 아니라는 점을 보여준다. 문제는 자연어처리(NLP) 시스템의 훈련 방식에 있다. 또한 이 문제는 자연어처리 시스템을 개선할 방법을 시사하기도 한다.

앨라배마주 오번대학(Auburn University)과 어도비 연구소(Adobe Research) 연구진은 자연어처리 시스템이 왜 서로 다른 문장을 같은 의미라고 주장하는 등의 행태를 보이는지 이유를 찾는 과정에서 이 문제점을 발견했다. 언어 모델들의 접근 방식을 테스트해 본 결과, 문장 속의 단어를 섞어도 결과에는 차이가 나타나지 않았다. 연구를 이끈 오번대 안 응옌(Anh Nguyen)은 “이 문제는 모든 NLP 모델에서 나타나는 보편적인 현상”이라고 주장했다.

연구팀은 구글이 개발한 언어 모델 BERT를 기반으로 하는 몇몇 최첨단 NLP 시스템을 들여다 보았다. 이들은 모두 GLUE(일반어 이해 평가: General Language Understanding Evaluation)에서 사람보다 더 높은 점수를 얻는다. GLUE는 같은 뜻을 다르게 표현한 문장을 찾는 능력이나, 문장에 담긴 정서가 긍정적인지 부정적인지 판단하는 능력, 언어 추론(Verbal Reasoning) 같은 언어 이해 능력을 인공지능에게 학습시키거나 평가하기 위해 고안된 과제들이다.