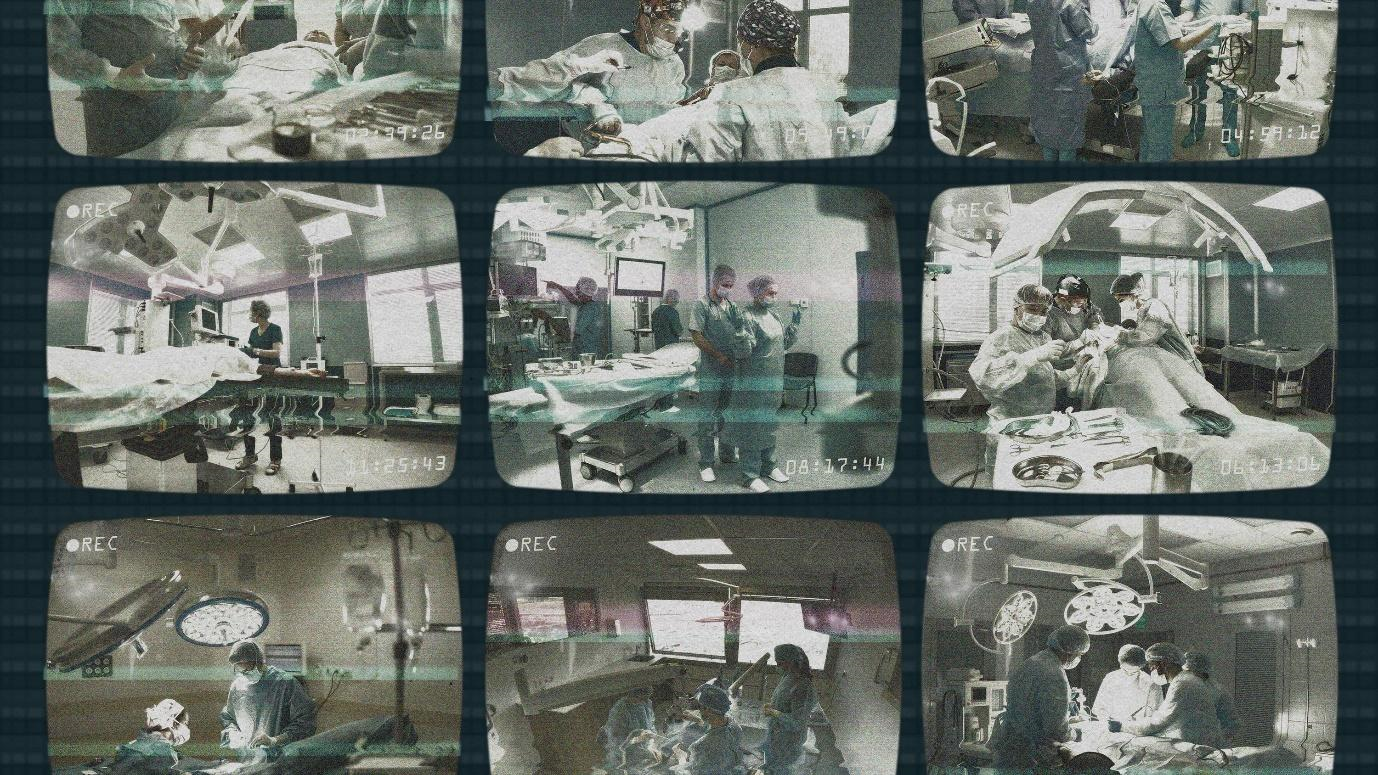

의료진 감시용 빅브라더?…수술실 AI 블랙박스 논란

미국에서는 매년 2만 2000명이 심각한 의료 과실로 사망하는데, 사망 사고의 상당수가 수술실에서 일어난다. 의사가 수술을 잘못해서 그런 사고가 나기도 하지만 심지어 환자의 체내에 수술용 거즈를 남기는 어처구니없는 실수를 저질러서 사고가 나기도 한다.

테오도르 그랜차로프(Teodor Grantcharov) 스탠퍼드 대학교 외과 교수가 비행기 블랙박스와 유사한 방식으로 작동하는 수술실용 ‘AI 블랙박스’를 개발한 건 이런 실수를 최소화하면서 더 안전한 수술을 할 수 있게 돕기 위해서다. 그가 세운 회사 ‘서지컬 세이프티 테크놀로지스(Surgical Safety Technologies)’에서 개발한 이 블랙박스는 파노라마 카메라와 천장에 설치한 마이크 및 마취 상황 감시 모니터 등을 통해 수술실의 모든 상황을 기록한 뒤에 AI를 사용해서 수술 집도의가 수술 상황을 자세하게 파악할 수 있게 돕는다. 블랙박스는 수술실 문이 열린 횟수부터 수술 중 수술과 관련 없는 대화가 얼마나 많이 오갔는지까지 수술실의 모든 상황을 감시하는 역할을 한다.

이러한 블랙박스는 이미 마운트 시나이, 듀크, 메이요 클리닉 등 미국, 캐나다, 서유럽 내 약 40개 병원에서 사용되고 있다. 그렇다면 이제 병원은 새로운 ‘안전한 시대’를 맞이하게 된 걸까? 그게 아니면 단지 의사들을 혼란으로 몰아넣고 있는 것은 아닐까?

모든 분야의 조직은 더 안전하고 효율적으로 일하기 위해 AI를 도입하는 방법에 대해 고민하고 있다. 병원의 경우 이런 AI 블랙박스를 활용했을 때 항상 긍정적인 점만 있는 건 아니다. 여전히 해결해야 할 문제도 많다.

예를 들어 이런 문제들이다.

첫째, 개인 정보 보호가 중요하지만 제대로 보장받지 못한다. 그랜차로프는 외과의사들이 블랙박스를 받아들이게 만들려면 그들이 개인 정보가 보호가 안 돼 피해를 입을 수 있다는 걱정에서 벗어나게 해줘야 한다는 사실을 곧바로 깨달았다. 그래서 그는 수술실에서 일어나는 모든 일을 기록하더라도 환자와 모든 의료진의 신원을 미공개로 하고, 30일 이내에 블랙박스의 모든 기록을 삭제할 수 있게 시스템을 설계했다. 실수를 저지른 당사자 신원이 파악돼 무조건 처벌을 받는 일이 일어나서는 안 된다는 게 그의 생각이다.

블랙박스는 녹화한 모든 사람을 익명으로 처리하고, 알고리즘을 통해 목소리를 왜곡하고, 얼굴을 흐리게 처리해 누아르 영화에 나올 법한 정체를 알기 힘든 인물로 변화시킨다. 따라서 무슨 일이 발생한다고 하더라도 이는 해당 인물에게 불리한 증거로 사용될 수 없다.

하지만 이 과정 역시 완벽하지는 않다. 30일이 지난 기록이 자동으로 삭제되기 전에는 병원 관리자가 수술실 방 번호, 수술 시간, 환자의 의료 기록 번호 등을 확인할 수 있어서 기술적으로 개인정보를 없애더라도 진정한 익명성이 보장되는 건 아니기 때문이다. 따라서 7개의 수술실에서 블랙박스가 운영되고 있는 듀크 대학병원의 임상 운영 부의장인 크리스토퍼 맨티(Christopher Mantyh)는 직원들이 “빅브라더(big brother)가 지켜보고 있다는 느낌을 받게 되었다”고 인정했다.

빅브라더는 사회학적 통찰과 풍자로 유명한 영국의 소설가 조지 오웰(George Orwell)의 소설 《1984년》에서 나온 용어로, 정보의 독점으로 사회를 통제하는 관리 권력이나 그러한 사회체계를 일컫는 말이다.

둘째, 병원 종사자들을 먼저 설득하지 않고서는 새로운 기술을 도입할 수 없다. 그들은 종종 새로운 도구에 대해 의심을 갖는다. 충분히 타당한 의심이다. 개인정보 보호와 관련된 시스템의 결함도 그들이 새 기술을 받아들이길 주저하게 만드는 이유다. 실제로 많은 의사와 간호사가 새로운 감시 도구를 적극적으로 거부했다. 한 병원에서는 카메라를 돌리거나 고의로 플러그를 뽑는 등의 방법으로 카메라 촬영을 방해했으며, 일부 외과의사와 병원 직원들은 카메라가 설치된 병실에서 근무하는 걸 거부했다.

초반에 일부 카메라가 부서지는 일도 벌어졌다. 이런 일이 벌어진 병원에서 외과의사들이 카메라에 익숙해지는 데까지 최대 6개월의 시간이 걸렸다. 하지만 직원들이 기술에 적용된 통제 장치를 이해한 후에는 그래도 블랙박스 촬영이 조금씩 더 순조롭게 진행됐다. 상사들이 직원들과 대면 면담을 통해 데이터가 어떻게 자동으로 비식별화되고 삭제되는지를 설명하며 이해시키자 비로소 직원들은 이 기술을 받아들이기 시작했다.

셋째, 확보 가능한 데이터가 늘어난다고 해서 항상 해결책을 쉽게 찾을 수 있는 건 아니다. 기술은 유용성을 스스로 입증해야 하며, 신기술이 단순히 신기술이라는 이유만으로 받아들여지지는 않는다. 하지만 AI 기술이 실제로 유용한지 판단하기는 쉽지 않다. 일부 병원에서는 블랙박스 데이터를 도입한 후 일부 치료 관련 지표가 개선되었다고 한다. 일례로 듀크 대학병원 의사들은 항생제가 제때 투여되는 빈도를 확인하고 수술실이 비어 있는 시간을 줄이기 위해 이 데이터를 활용하고 있다고 보고했다.

그러나 블랙박스가 실제로 환자의 합병증과 사망률을 줄여주는지와 관련된 대규모 임상 연구 데이터는 아직 보고된 바 없다. 이것 역시 많은 병원들이 이 시스템을 도입하기를 거부하고 있는 중요한 이유 중 하나다. 마운트 시나이의 일반외과 과장인 셀리아 디비노(Celia Divino)는 “과도하게 많은 데이터는 오히려 해로울 수 있다”면서 “그렇게 많은 자료를 어떻게 해석하고 활용해야 하는가가 항상 관건”라고 말했다.