AI 감정인식 기술을 규제하려는 이유

최근 필자는 뉴욕시에서 가장 좋아하는 장소인 공공 도서관에 가서 영국의 유명한 과학자 찰스 다윈(Charles Darwin)이 남긴 수백 통의 편지, 저서, 사색한 내용 등을 살펴보았다. 다윈은 글쓰기를 좋아했고, 그가 남긴 글 페이지마다 그의 호기심과 뛰어난 관찰력이 생생하게 살아 숨 쉬고 있었다.

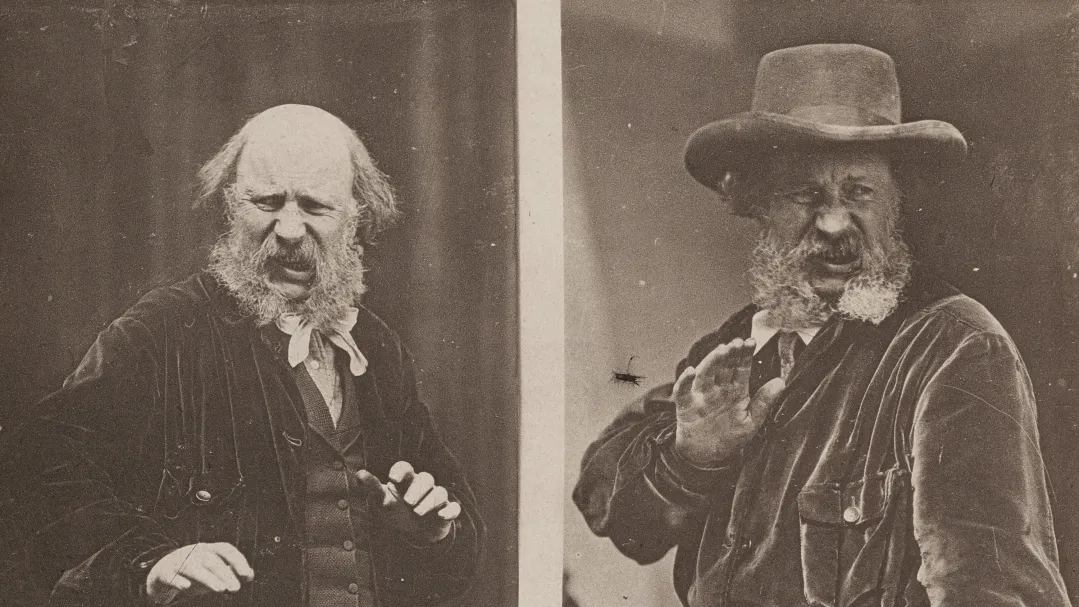

다윈은 진화론 외에도 사람과 동물의 표정과 감정에 대해 연구했다. 감정이 실제로 얼마나 과학적이고 보편적이며 예측 가능한지에 대한 글을 남기기도 했고, 그가 그린 과장된 표정의 인물 스케치가 이 도서관에 전시되기도 했다.

이러한 인간의 감정이라는 주제를 보면서 떠오르는 내용이 있었다.

최근 챗GPT, 범용 인공지능(AGI), 로봇이 인간의 일자리를 빼앗을 것이라는 전망 등에 모두가 격분하고 있는 상황에서 규제당국은 인공지능(AI)과 감정인식(emotion recognition)에 대한 경계를 강화하고 있다.

앞서 언급한 다윈과는 거리가 멀게 느껴지는 ‘감정인식’은 영상, 얼굴 사진, 오디오 녹음 등에 대한 AI 분석을 통해 사람의 감정이나 마음 상태를 파악하려는 시도이다.

아이디어 자체는 간단하다. 예를 들어 AI 모델이 입을 벌리고, 눈을 가늘게 뜨고, 고개는 뒤로 젖힌 채 볼이 수축하는 모습을 보면, 이를 웃음으로 인식하여 대상이 행복하다는 결론을 내릴 수 있다는 것이다.

하지만 실제로 감정인식은 그렇게 간단하지 않다. 게다가 일부에서는 감정인식이 AI가 종종 만들어내는 일종의 ‘사이비 과학’을 보여주는 위험한 사례라고 주장하기도 한다.