멀티태스킹을 학습하는 AI

인공지능(AI) 기업 딥마인드(DeepMind)가 AI 학습에 사용하기 위해 알록달록한 색으로 꾸민 거대한 가상 놀이터 ‘엑스랜드(XLand)’를 개발했다. 엑스랜드는 끊임없이 새로운 과제를 부여하는 방식으로 AI에게 전반적인 기술을 가르친다. 단순히 특정 과제를 해결하는 데 필요한 기술을 개발하는 대신, AI들은 여러 기술을 실험하고 탐구하고 익힌 뒤 이전에 경험해본 적 없는 과제를 수행해낸다. 이러한 방식은 AI가 사람처럼 생각하고 판단할 수 있는 일반 지능(general intelligence)을 발전시키는 방향으로 나아갈 출발점이라고 할 수 있다.

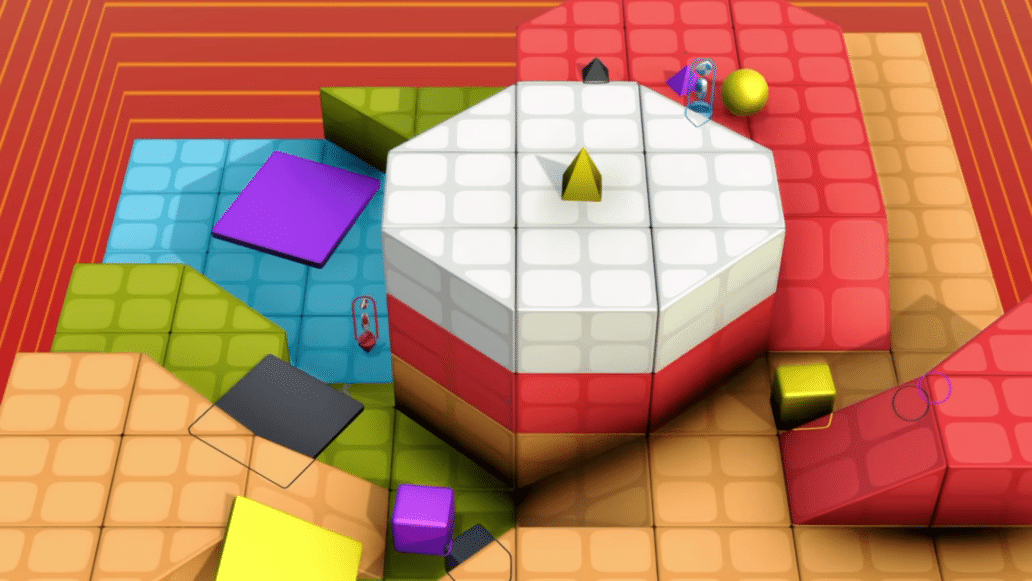

엑스랜드란 무엇인가? 엑스랜드(XLand)는 비디오 게임과 유사한 3D 공간으로, AI 플레이어들은 색깔을 통해 이 공간을 감지할 수 있다. 이 공간을 관리하는 ‘중앙 AI(central AI)’는 게임 환경과 규칙, 플레이어 수를 바꾸는 방식으로 이곳을 이용하는 AI 플레이어들에게 수십억 개의 다른 과제를 부여한다. 이러한 과정에서 AI 플레이어들과 관리자 AI는 강화 학습(reinforcement learning) 방식으로 시행착오를 겪으며 성능을 높인다.

훈련 과정에서 플레이어들은 처음에 보라색 큐브 찾기나 빨간색 바닥에 노란 공 놓기 같은 단순한 1인용 게임을 수행한다. 그 이후에는 숨바꼭질이나 깃발 빼앗기 놀이 같이 더 복잡한 다인용 게임을 수행하게 된다. 관리자 AI는 어떤 구체적인 목표를 달성해야 할 필요는 없지만, 다른 플레이어들의 전반적인 수행 능력을 개선해야 한다.