AI 챗봇은 왜 실패하는가 : 이루다가 남긴 과제 Ⅱ

이루다 문제가 불거진 이후 인공지능에 대한 규제와 감시 논의가 활발해지고 있다. 그러나 규제가 실제 문제를 해결할 수 있을지는 미지수다.

부풀려진 기대감

이루다 이전에도 “AI가 5년 안에 인간 수준에 가까운 대화를 할 수 있다”거나 “챗봇의 황금기가 곧 도래한다”는 낙관적 전망들은 넘쳐났다. 이루다의 실패는 캐시 오닐(Cathy O’Neil)의 말처럼 알고리듬을 맹신하는 우리의 태도에 문제가 있는 것은 아닌가를 돌아보게 해준다. 챗봇 개발과정에서 나타나는 기술적 한계나 맹점은 잊고 기대를 걸거나 챗봇이 완전한 사람이라고 믿는 것은 아닐까? 그러나 사람처럼’(human-like) 대화하는 지능적 챗봇이 가까운 시일 이내에 구현되리라고 낙관하기는 어려운 실정이다. 대화상대가 말하는 뉘앙스와 의도를 정확히 파악하고 감정을 예측하는 수준도 아니다. ‘AI 챗봇’은 그 이름값과는 달리 실제로는 기술적 한계와 드러나지 않은 잦은 오류로 점철되어 있다.

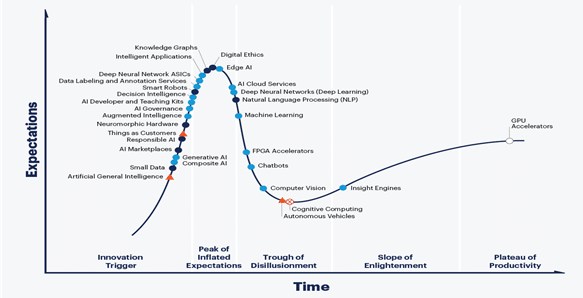

가트너(Gartner)가 내놓은 AI 하이프 사이클(hype cycle) 2019에서 AI 챗봇에 대한 기대감은 한껏 고조되어 거의 정점에 이르렀다. 하이프 사이클 모델은 기술의 성숙도, 수용도, 사업화 수준을 보여준다. 고기능 AI 챗봇에 대한 추구는 분명하지만 이를 구현하기 위해 필요한 자연어 생성 기술의 발전은 아직 그 기대에 미치지 못했기 때문에, 미디어에 보도된 일부 성공 사례를 제외하고는 개발과정에서 많은 실패를 경험하게 된다. 그 결과 2020년 분석에서 AI 챗봇은 기대감의 거품에서 벗어나 현실적 한계를 깨닫는 시기로 진입했다.