STEPHANIE ARNETT/MITTR

AI hype is built on its high test scores. Those tests are flawed.

결함 있는 테스트로 부풀려진 대형언어모델 (LLM)

다양한 분야에서 커다란 반향을 일으키고 있는 대형언어모델(LLM)에 대해 기대와 두려움이 공존하고 있다. 이제 이 기술의 진정한 강점과 한계가 무엇인지에 대해 명확한 합의를 도출할 때다.

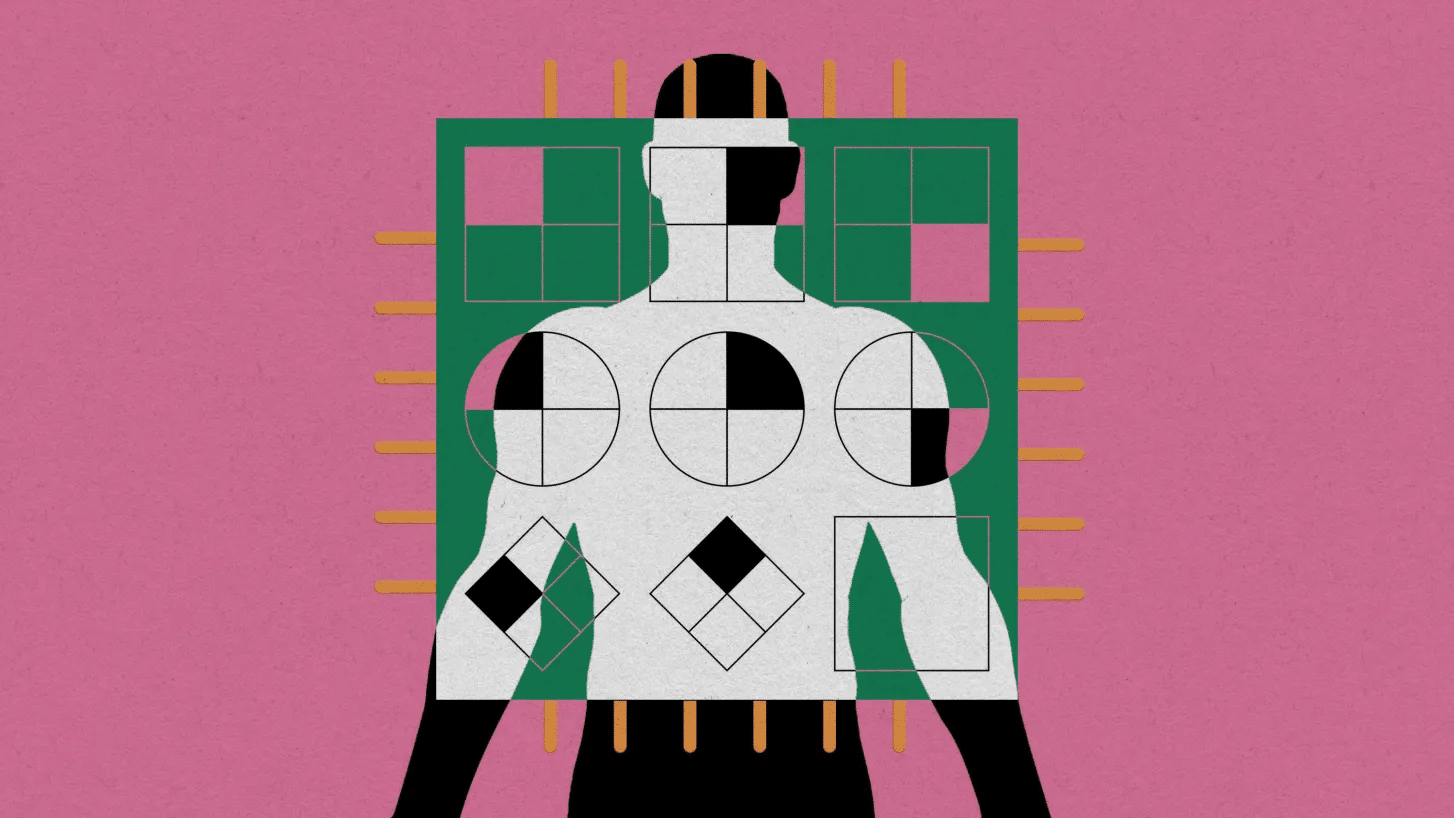

2022년 초 GPT-3의 다양한 기능을 테스트하던 심리학자 테일러 웨브(Taylor Webb)는 오픈AI가 만든 이 대형언어모델(LLM)이 보여주는 무궁무진한 가능성에 크게 놀랐다. GPT-3는 텍스트의 다음 단어를 예측하도록 훈련된, 즉 자동 완성 기능(jumped-up autocomplete)을 갖춘 신경망이었으나 웨브가 준비한 IQ 검사에서나 나올 법한 추상적인 문제들까지도 막힘 없이 풀어냈다. 웨브는 “이러한 문제를 풀어내는 GPT-3의 능력에 큰 충격을 받았다”며 “전혀 예상하지 못했던 의외의 결과였다”고 말했다.

웨브는 현재 미국 캘리포니아 대학교 로스앤젤레스 캠퍼스에서 인간과 컴퓨터가 추상적인 문제를 해결하는 방식의 차이를 연구한다. 그는 이미 특정 추론 기능이 탑재된 신경망을 여러 번 개발해 본 경험이 있다. 하지만 GPT-3는 추론 기능을 스스로 습득한 것처럼 보였다.

지난 7월 웨브와 동료들은 <네이처(Nature)>에 일명 ‘유추적 추론’이라고 불리는 유사성을 이용해 문제를 해결할 수 있는 능력을 평가하기 위해 개발된 다양한 시험을 GPT-3가 통과할 수 있다는 내용의 논문을 기고했다. GPT-3는 일부 시험에서 대조 집단인 학부생들보다 더 고득점을 받았다는 것이다. 웨브는 “유추는 인간의 추론 능력 중 가장 중요한 요소”라며 “우리는 이 능력을 모든 종류의 기계 지능이 증명해야 할 주요 역량 중 하나라고 생각한다”고 밝혔다.