Error-riddled data sets are warping our sense of how good AI really is

AI 학습시키는 데이터세트, 믿을만한가?

테스트 데이터 결함으로 머신러닝에 대한 사람들의 생각은 왜곡되었다.

MIT의 새로운 연구에 따르면, 가장 많이 인용된 AI 데이터세트 10개가 라벨 오류로 가득하며 그 결과 관련 분야에 대한 사람들의 생각이 왜곡되고 있다.

데이터 백본(Data Backbone): 데이터 세트는 AI 연구의 근간을 이루지만, 이 보다 더 중요한 것도 있다. 시간이 흐름에 따라 AI 기능이 어떻게 발전하는지를 파악하기 위한 방법으로 연구진이 머신러닝 모델 평가에 사용하는 핵심 데이터 세트가 있다. 제일 유명한 케이스는 현대 AI 혁명을 탄생시킨 표준 이미지 인식 데이터 세트 이미지넷(ImageNet)이다. 0에서 9까지 손으로 쓴 숫자 이미지로 이루어진 MNIST도 있다. 또한, 오디오, 텍스트, 손 그림을 인식하도록 훈련된 모델을 테스트하는 데이터 세트도 있다.

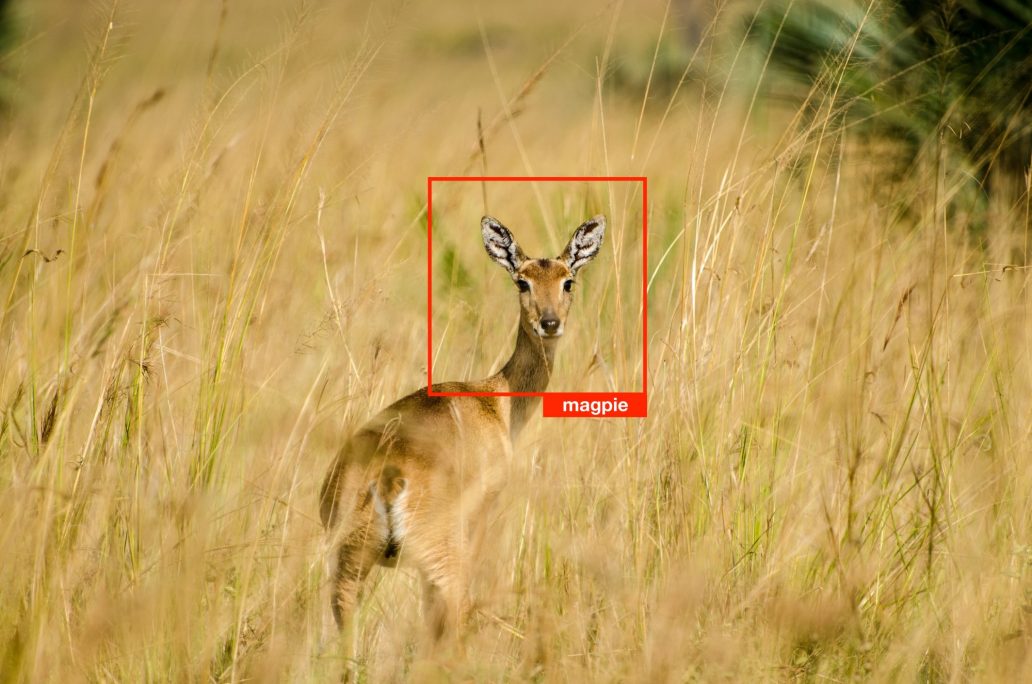

하지만: 최근 몇 년 동안의 연구에 따르면 이 데이터 세트에는 심각한 오류가 포함되어 있다. 예를 들면, 이미지넷은 인종차별 및 성차별주의 라벨을 포함하고 있을 뿐만 아니라, 사람들의 동의 없이 얼굴 사진도 사용하고 있다. 라벨이 완전히 틀린 경우도 많은데 이에 대해서도 연구가 진행 중이다. 버섯은 숟가락(Spoon), 개구리는 고양이(Cat), 아리아나 그란데(Ariana Grande)의 높은 음은 호루라기(Whistle)라고 되어 있다. 이미지넷 테스트 세트의 예상 오류율은 5.8%이다. 한편, 손 그림 모음인 퀵드로우(QuickDraw) 테스트 세트의 오류율은 10.1%에 달한다.