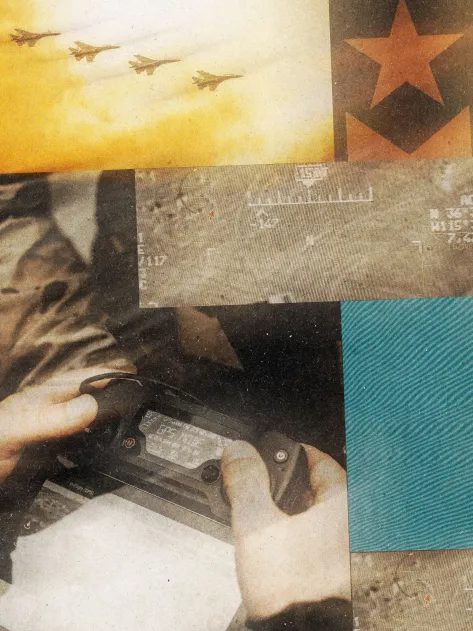

Stephanie Arnett/MIT Technology Review | Getty Images, Public Domain

The new war room

새로운 작전실

군 당국은 이미 인간이 놓칠 수 있는 부분을 포착하기 위해 AI를 활용하고 있다. 이제 그들은 지휘관들이 전투 중에 참고할 수 있는 조언형 시스템도 원하고 있다.

이란에서 벌어지고 있는 분쟁을 최초의 ‘AI 전쟁’이라고 부르는 것은 여러 측면에서 정확하지 않다. 수 시간 분량의 감시 영상을 분석해 기관총이 장착된 트럭과 같은 표적을 식별하는 알고리즘은 이미 아프가니스탄 전쟁 시기부터 사용돼 왔다. 우크라이나는 AI를 활용해 자율적으로 항로를 찾는 드론을 개발했고, 이스라엘 역시 정보 데이터를 기반으로 잠재적 표적을 식별하는 데 AI 시스템을 활용해 왔다.

이란을 비롯한 여러 지역에서 새롭게 등장한 것은, 지휘관들이 단순한 분석을 넘어 ‘조언’을 얻기 위해 사용하는 대화형 AI 시스템이다. 기존 AI 기술과 달리 이러한 조언형 시스템은 대형언어모델(LLM)을 기반으로 한다. 그리고 이들은 이미 군이 정보를 공유하고, 빅테크 기업과 협력하며, 생사를 가르는 결정을 내리는 방식을 바꾸고 있다.

10년 전만 해도 AI 도구는 하급 정보 분석관의 업무를 자동화하는 수준에 머물렀다. 소셜미디어나 위성 영상에서 방대한 잡음 속 의미 있는 신호를 가려내는 작업이 대표적이다. 감시 기술 기업 팔란티어의 기술을 기반으로 구축된 미군의 ‘메이븐(Maven)’과 같은 시스템은 이러한 분석 결과를 지휘관에게 제공했다. 이를 통해 지휘관은 전쟁 장비라기보다 비즈니스 소프트웨어에 가까운 깔끔한 인터페이스를 이용해 지구 반대편의 공격 목표를 선택할 수 있었다.