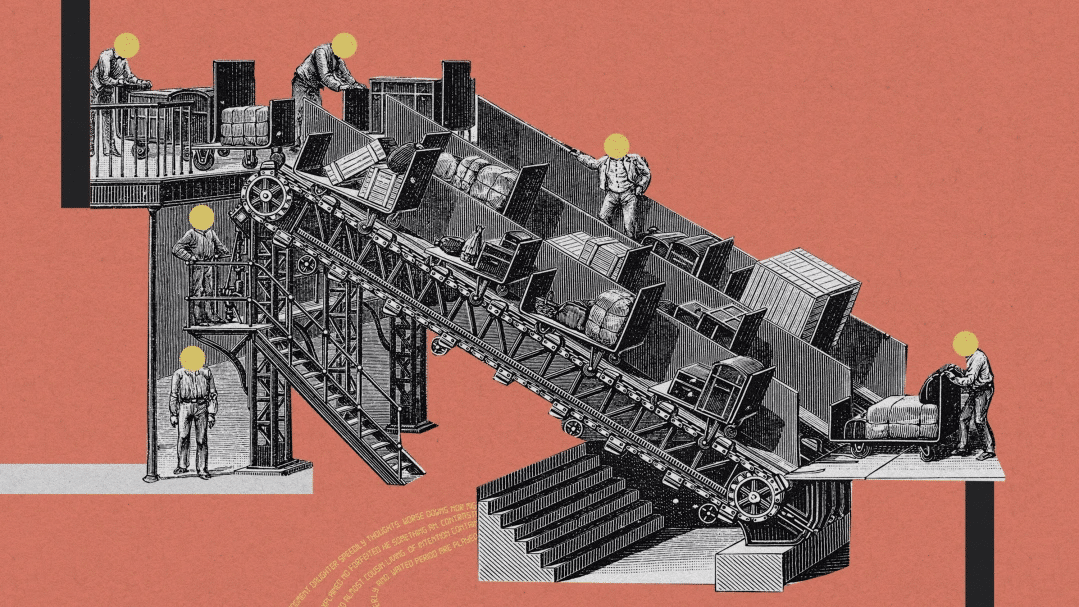

STEPHANIE ARNETT/MITTR | GETTY

The people paid to train AI are outsourcing their work… to AI

AI 생성 데이터로 AI를 학습시키면 예상되는 문제는?

AI 모델의 학습 데이터를 외주 받는 긱 노동자 중 상당수가 AI를 쓰는 것으로 밝혀졌다. 이러한 관행은 AI 모델이 미래에 잘못된 정보를 제공할 가능성을 더 높인다.

최근 한 연구를 통해 AI 모델의 학습 데이터를 외주 받는 사람 중 상당수가 그 작업을 AI에 맡기는 것으로 밝혀졌다.

AI 시스템이 특정 작업을 정확하고 확실하게 수행하도록 학습하려면 엄청난 양의 데이터가 필요하다. 그래서 많은 기업이 메커니컬 터크(Mechanical Turk)와 같은 플랫폼의 긱(gig) 노동자들에게 자동화하기 어려운 작업을 맡긴다. 캡차(CAPTCHA, 사람과 로봇을 구별하는 인증 절차) 통과, 데이터 라벨링, 텍스트 어노테이팅(주석 작업) 등이 여기 해당한다. 이후 이 데이터는 AI 모델의 학습에 사용된다. 데이터 작업을 하는 긱 노동자들은 낮은 급여를 받고 작업을 신속히 완료해야 하는 경우가 많다.

이들 중 일부는 분명 수익의 극대화를 위해 챗GPT와 같은 도구를 사용하고 있을 것이다. 그렇다면 그 비중이 얼마나 될까? 이를 알아내기 위해 스위스 취리히 연방 공과대학교의 연구팀이 나섰다. 이 연구팀은 긱 작업 플랫폼인 아마존 메커니컬 터크에서 44명을 고용해 16편의 의학 논문 초록을 요약하는 작업을 맡겼다. 그리고 한정된 단어 사용과 같은 챗GPT 답변의 특징을 찾도록 직접 학습시킨 AI 모델로 결과물을 분석했다. 또한 작업자들의 키보드 입력 정보를 추출해 내용을 복사해 붙여 넣었는지도 확인했다. 이 정보는 해당 내용을 다른 곳에서 생성했을 가능성을 나타낸다.