알고리즘에 오신 것을 환영합니다!

올해 우리는 ‘생성형 AI(generative AI)’ 분야에서 아찔할 정도로 많은 기술 혁신을 목격했습니다. 단어 몇 개만 갖고도 영상을 제작하는 AI에서 노래 한 소절을 바탕으로 오디오를 생성하는 AI에 이르기까지 다양한 혁신적 모델이 등장했죠.

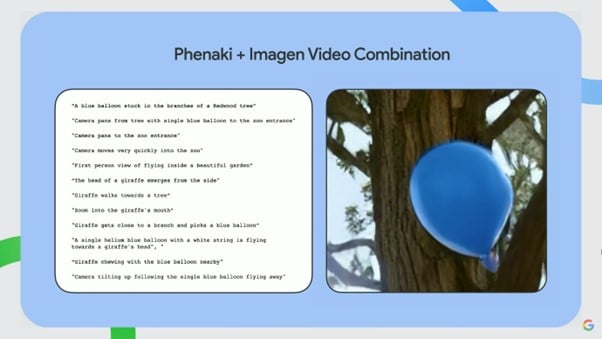

최근 구글은 뉴욕시 맨해튼 허드슨 강변에 위치한 호화로운 새 사무실에서 AI 행사를 열었습니다. 이 행사에서 구글은 텍스트를 입력하면 영상을 생성하는 두 가지 ‘텍스트투비디오(text-to-video)’ AI 모델인 페나키(Phenaki)와 이매젠(Imagen)을 결합한 시스템 등 생성형 AI의 엄청난 발전을 예고했습니다. 이매젠이 고화질 영상을 만드는 데 초점을 맞추고 있다면, 페나키는 명령어를 통해 긴 분량의 영상을 만들어주는 게 특징입니다.

하지만 아직 일반 대중이 사용하려면 이러한 모델들은 더 많이 발전해야 합니다. 이러한 모델들 대부분이 인터넷에서 긁어모은 데이터를 바탕으로 학습을 진행합니다. 그런데 그러한 데이터의 속성상 폭력적이거나 성차별적이거나 인종차별적이거나 저작권을 침해하는 콘텐츠를 생성하는 등의 문제를 낳고 있죠. 한 구글 연구원은 생성형 AI 모델들이 아직 초기 수준에 있으며 실제 제품에 사용될 수 있으려면 많은 조정작업이 필요하다고 말했습니다. 생성형 AI 분야는 매우 인상적이지만 구글이 이 기술을 통해 어떻게 수익을 창출할 수 있을지도 불분명합니다.