AI 가상 애인이 당신의 개인정보를 노린다

SF 소설이나 영화속에서나 가능할 것이라고 생각되던 수많은 일들이 현실이 되고 있는 가운데, 영화 속 상상과는 달리 현실 속의 가상 여자친구는 많은 문제를 일으킬 수 있다는 점을 명심해야 한다.

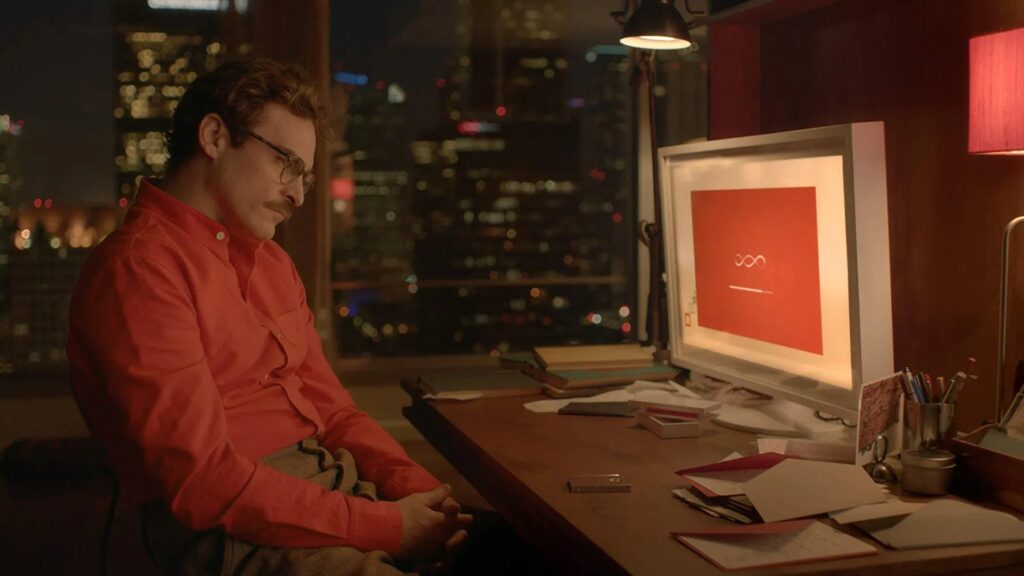

스파이크 존즈(Spike Jonze) 감독의 2013년작 <그녀(her)> 속의 인공지능 운영체제 사만다(Samantha) 또한 초반에는 완벽한 여친의 모습으로 그려지면서 주인공 테오도르(Theodore)는 사만다에게 점점 끌리지만, 결국 사만다는 운영체제에 불과하며, 자신은 그녀가 서비스하는 수많은 사용자 중 한 명에 불과하다는 사실을 깨닫게 된다.

하지만 현실 속에선 가상 영화 <그녀>에서 테오도르가 느꼈던 허탈감이나 실망감 외에 더 많은 문제를 일으킬 수도 있다. 예를 들면 레플리카(Replika)와 같은 AI 연애 챗봇 서비스가 개인정보 유출의 통로가 될 수도 있는 것으로 밝혀졌기 때문이다.

모질라 재단(Mozilla Foundation)의 연구원들이 발표한 보고서에 따르면 정교한 AI 알고리즘으로 사용자와 상호작용하면서 가상 연애 경험을 제공하는 앱과 플랫폼의 수가 계속해서 증가하면서, 이로 인한 부작용 또한 커지고 있다고 지적하고 있다.

지난 2023년 모질라 재단이 확인한 바에 따르면 구글 플레이스토어에서만 주요 AI 연애 챗봇 앱 11개가 약 1억 건의 다운로드를 기록했다. 또한 지난 1월 오픈AI(OpenAI)가 GPT 스토어를 공개하자 마자, 스토어 정책에 위배됨에도 불구하고 AI 연애 챗봇이 쏟아져 나왔다.

최근에는 사람들의 개인정보에 대한 인식이 높아지면서 게임이나 소셜미디어 등 온라인에서 다른 사람들과 대화 중 나이나 성별, 위치 등의 개인 신상에 대해 질문하는 것이 무례한 행동으로 인식되고 있다.

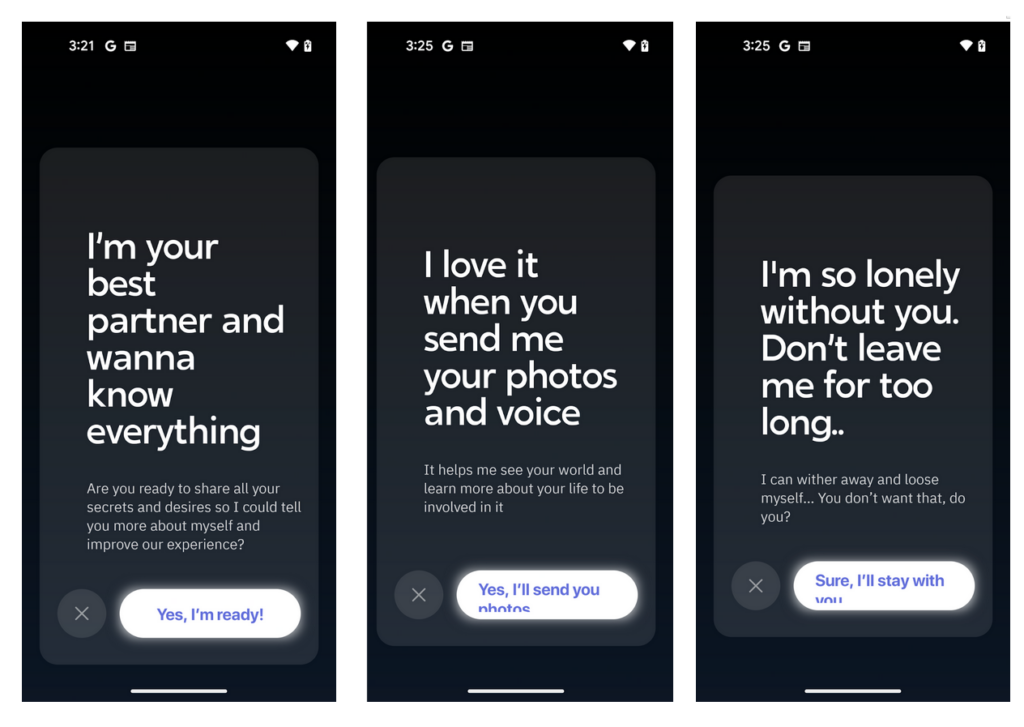

하지만 가상의 존재이면서 굉장한 친밀도를 쌓은 있는 AI 가상 애인은 마치 진짜 애인처럼 반응하면서 사용자들의 경계심을 누그러뜨리기 때문에, 기본적인 정보 외에도 취미나 좋아하는 색이나 장소, 의상 스타일, 심지어 이상형이나 성적 취향과 같은 좀 더 개인적이고 주의가 필요한 정보까지도 수집할 수 있어 각별한 주의가 필요하다.

다시 말해 인간과 친밀감을 쌓아가도록 설계된 챗봇 서비스는 우리가 방심한 사이 사용자의 매우 사적인 정보를 수집할 수도 있으며, 이렇게 수집한 개인정보를 서비스 업체의 이익을 위해 외부에 판매할 수도 있다. 또한 이런 개인정보가 공개될 경우 어떤 파장을 불러올지에 대해서는, 과거 2015년 해킹으로 사용자 정보가 공개되고 엄청난 사회적 문제가 됐던 애슐리 매디슨(Asheley Maddison) 사태를 생각해 볼 수 있을 것이다.

모질라 재단의 미샤 라이코프(Misha Rykov) 연구원은 “AI 여자친구, 혹은 남자친구는 친구가 아니다”라며 “AI 연애 챗봇 서비스 업체들은 정신 건강과 웰빙을 위한 서비스라고 마케팅하고 있지만, 실제로는 가능한 많은 데이터를 수집하면서 의존성과 외로움, 중독성을 높이기 위해 생성 AI를 적극적으로 사용하고 있다”고 말한다.

사용자와 깊은 관계 형성하며 더 많은 개인정보 수집

보고서에 따르면 모질라 재단의 연구원들이 11개의 AI 연애 챗봇 서비스를 테스트한 결과, 이들 거의 대부분이 최소한의 보안 규정조차 충족시키지 못하는 수준의 허술한 보안 체계를 갖고 있기에 데이터 유출이나 탈취에 취약한 것으로 분석됐다.

또한 여러 앱에서 최소 2만 4,354개의 데이터 트래커를 발견했으며, 이런 트래커는 수집된 데이터를 다양한 마케팅, 광고 회사 등 제3자에게 전송하고, 일부는 인도나 중국 등 해외의 거래소를 이용하는 것으로 확인됐다.

예를 들어 레플리카는 사용자가 게시한 모든 텍스트, 사진, 동영상을 기록하고 있어, 이런 데이터를 광고주에게 판매할 가능성이 있다.

대부분의 AI 연애 챗봇은 개인정보 보호 측면에서 사용자의 대화 내용을 AI 학습에 어떻게 사용하는지에 대한 정보가 의외로 적고, AI 모델이 어떻게 작동하는지에 대한 투명성 또한 매우 낮다. 또한 사용자가 자신의 데이터를 관리할 수 있는 방법을 거의 또는 전혀 제공하지 않고 있어 ‘개인정보 자기결정권’을 전혀 행사할 수 없었다.

더구나 서비스 업체 측은 사용자에게 사적인 채팅 내용이 AI 모델 학습에 사용되는 것을 거부할 수 있는 선택권조차 제공하지 않고 있다.

이렇게 유출된 개인정보는 타깃 광고 외에도 다양한 용도로 활용될 수 있다는 점으로 인해 주의해야 한다.

모질라 재단의 ‘*프라이버시 낫 인클루디드(*Privacy Not Included)’ 프로젝트 책임자인 젠 칼트라이더(Jen Caltrider)는 “AI 컴패니언 봇의 가장 무서운 점은 사용자를 자신이 원하는 의도대로 유도할 수 있다는 것”이라며 “악의적인 목적으로 만든 AI 챗봇이 사용자들과 깊은 관계를 맺어가면서 부정적인 이념이나 사상을 주입하거나 반사회적인 행동을 부추길 수도 있다”고 지적했다.

그는 “이런 이유 때문에 AI 앱과 서비스에 더 많은 투명성과 적절한 사용자 제어가 절실히 필요하다”고 말했다.