[전문가 칼럼] 신약 개발에서 정밀의료까지… 의료 혁신 이끄는 양자헬스케어FREE

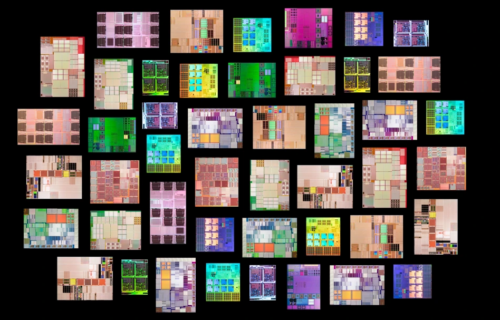

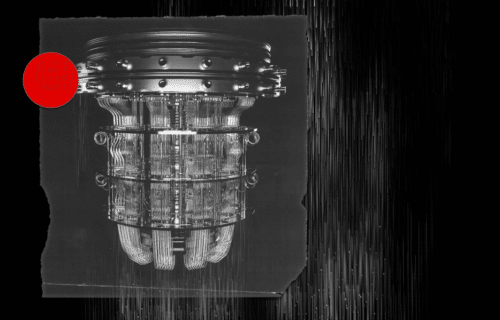

양자컴퓨팅이 헬스케어를 근본적으로 재정의하고 있다. 기존 컴퓨터로는 수개월이 걸리는 신약 후보 탐색, 유전체 분석, 정밀의료 모델링이 양자 알고리즘과 하이브리드 AI 시스템의 결합으로 단기간 내 가능해지고 있다. 전 세계 연구기관과 제약사들은 양자를 새로운 의료 혁신의 동력으로 삼고 있다. 아직 기술적 한계는 존재하지만, 의료 현장에 실질적인 변화를 가져올 '양자헬스케어'의 시대는 예상보다 빠르게 다가오고 있다.